深信服AICP算力平台在2024数字中国创新大赛两个赛道获奖

|

在近日圆满举办的2024数字中国创新大赛中,深信服AICP算力平台获得2个奖项! 《基于私有化大模型的推理训练一体化 Al算力平台》 2024数字中国创新大赛·信创赛道 行业贡献奖 2024数字中国创新大赛·城市赛道 二等奖

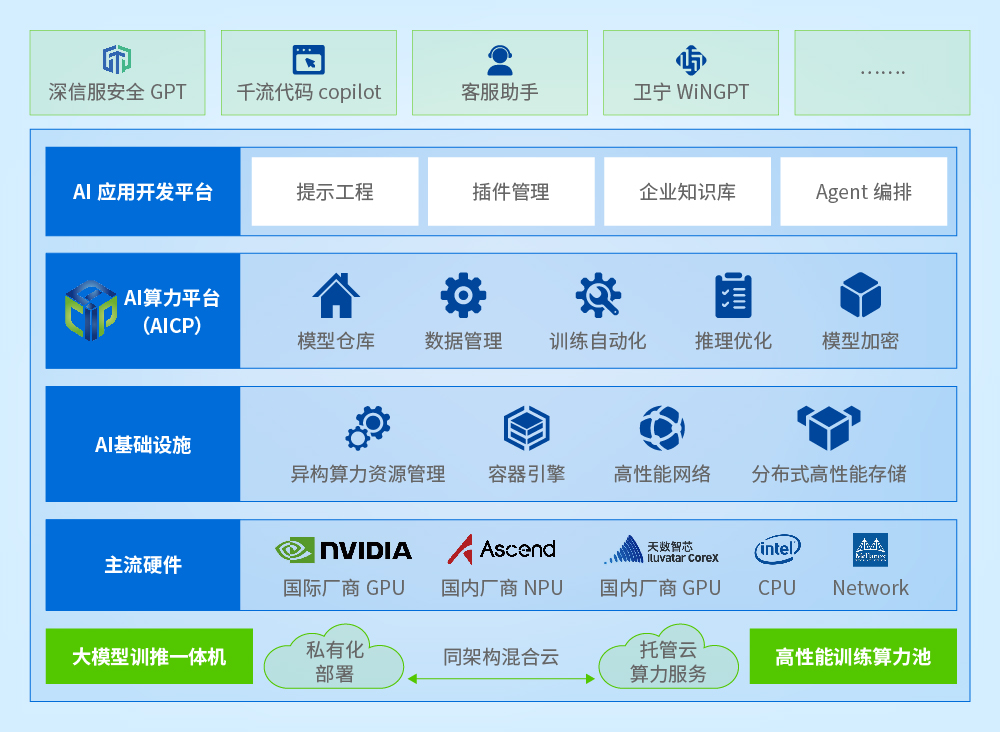

在垂直领域拥有自己的私有化大模型,已逐渐成为业界共识,但研发门槛高、使用成本高、安全风险高等痛点正在阻碍大模型落地的效率。深信服于今年3月份正式发布AICP算力平台,面向各行各业大模型开发部署场景,提供一站式大模型训练和推理能力,为用户提供向导化配置、一键训练;一半成本、五倍性能;模型加密、保护知识产权的业务价值。

深信服AICP算力平台解决方案 打造让更多用户用得上的AI,是深信服AICP算力平台的产品愿景。借由本次获奖的机会,深信服AICP算力平台展现其最新能力: 一、向导化配置,一键训练 深信服AICP算力平台能够管理异构算力GPU资源池,并内置了主流的开源基模型、丰富的开源数据集,包括中英文语料库,以及医疗、金融、教育、法律等垂直领域的开源数据等,可帮助用户简化训练准备过程。 用户通过三步向导式操作,选择基模型、选择数据配比、选择算力资源池,即可一键开启训练任务,无需自行配置100多项复杂的超参数。 同时,通过三大关键指标监控和处置,使模型训练过程一目了然,可有效保障训练稳定、高效训练出垂直大模型。 1、实时资源监控:实时监控GPU、CPU、内存、存储指标,及时调整,防止训练中断。 2、Checkpoint管理:本地SSD中保存最新模型状态,即便训练中断也可快速恢复。 3、Loss曲线可视:曲线震荡或者上升及时调整训练数据;曲线下降并趋于稳定,表示训练效果良好。 二、一半成本,五倍性能 针对使用成本高,平台内置大量训练和推理优化技术,创新地提供基于业务感知量化(BAQ)能力,在不损失大模型在垂直领域效果的同时,让推理性价比得到数倍的提升。 1、通过模型量化,使模型显存占用减少50%,需要的GPU数量减少50%。 2、创新的业务感知量化技术BAQ,保证量化后垂直领域业务效果无损。 3、联合CPU和GPU进行通信优化,让系统总吞吐提升超过20%。 4、结合业务数据的注意力稀疏技术,降低显存占用,让推理并发用户数提升30%。 5、对推理缓存进行了混合精度压缩,让系统总吞吐提升超过30%。 三、模型加密,保护知识产权 针对安全风险高的问题,平台内置业界独有的模型动态加密能力,有效保护用户知识产权,防止核心的模型资产泄露。 同时,在这些核心技术以外,深信服AICP算力平台还积极推进信创生态构建。 提供对AI技术栈的良好兼容性,通过软硬件联合调优,满足大模型训练、推理任务对算力和性能的要求,让用户在信创环境中也能进行大模型项目的开发和应用,同时满足合规和业务建设需求。 深信服和国内厂商开展了广泛的软硬件兼容测试,如华为昇腾系列NPU、天数智芯全自研通用GPU等等,从测试结果看,在相同硬件成本下,国内厂商推理卡性能表现出色,能够在信创场景实现大模型任务承载。 深信服多年来坚持AI First的研发战略,积极探索先进的AI技术应用,未来将持续以创新能力为用户带来更多智能化、个性化的AI解决方案。 |